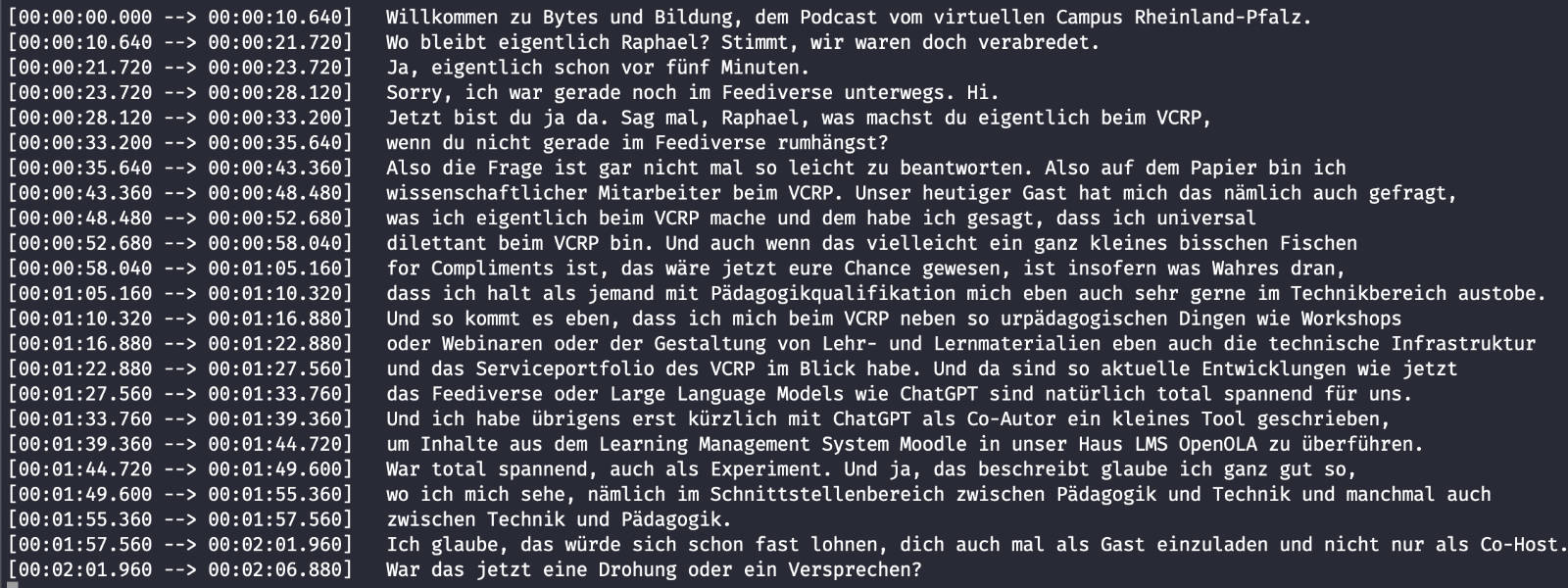

Kürzlich wollte ich Whisper AI lokal ausprobieren, um einen Audio-Podcast zu transkribieren. Das Ergebnis kann sich echt sehen lassen, wie ich finde:

Damit das Transkriptionsmaterial nicht in einer fremden Cloud landet, kann man entweder Software kaufen, die einem gegen kleines Geld die Konfiguration und Installation abnimmt und eine grafische Oberfläche anbietet. Oder man setzt mit Whisper.cpp ein kostenloses Tool zusammen, das mit einem Einzeiler auf der Kommandozeile die Transkription einer Datei durchführt.

Whisper.cpp auf dem Mac installieren

Ich habe mich an folgende Installationsanleitung von castopod.org gehalten, die ich problemlos abarbeiten konnte. Da ich die Vorbedingungen (Xcode, ffmpeg, brew) eh schon erfüllt hatte, bestand die Installation lediglich aus dieser Abfolge (Repository klonen, kompilieren, Sprachmodell herunterladen):

git clone https://github.com/ggerganov/whisper.cpp.git ~/apps/whisper.cpp

cd ~/apps/whisper.cpp

make

./models/download-ggml-model.sh largeTranskribieren

Whisper besteht auf Wavedateien mit 16KHz, daher muss das Eingabematerial umgewandelt werden:

ffmpeg -i /path/to/input.mp3 -ar 16000 -ac 1 -c:a pcm_s16le /path/to/input.wavUnd dann kann Whisper mit der WAV-Datei gefüttert werden:

~/apps/whisper.cpp/main -m ~/apps/whisper.cpp/models/ggml-large.bin --output-srt --language de -f /path/to/input.wavWir erhalten nach entsprechender Verarbeitungsdauer im Verzeichnis der Eingabedatei eine Untertiteldatei input.srt, die wir (z.B. als Videountertitel oder Podcast-Transkription) weiterverarbeiten können.